用视觉压缩文本!清华、智谱推出Glyph框架:通过视觉-文本压缩扩展上下文窗口

学术头条

2025-10-21 19:00

文章摘要

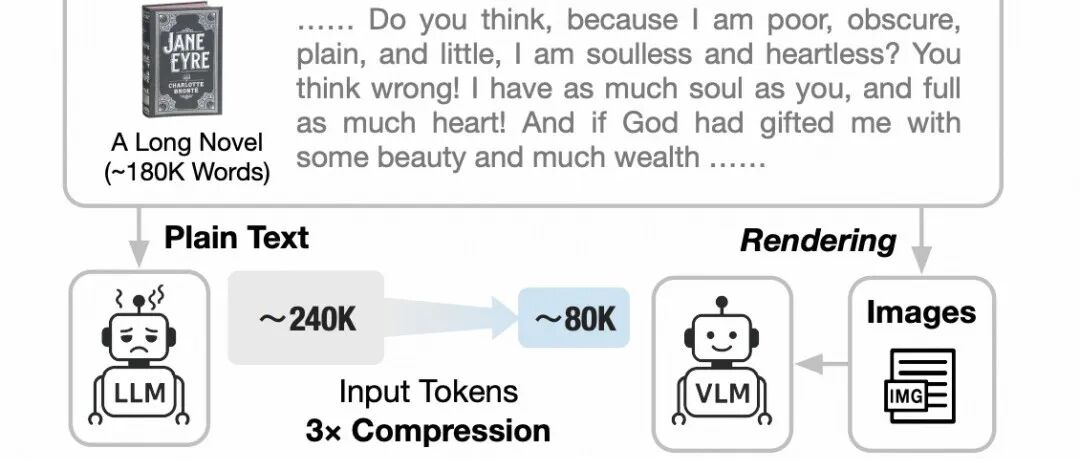

背景:长上下文建模是大模型发展的关键方向,但扩展到百万token级时面临计算和内存成本激增的挑战。研究目的:清华大学和智谱团队提出Glyph框架,通过将文本渲染为图像进行视觉压缩,以提升上下文窗口的信息密度。方法包括持续预训练建立跨模态对齐、LLM驱动的遗传搜索优化渲染策略、后训练强化细节理解。结论:实验表明Glyph实现3-4倍token压缩,在LongBench等基准上保持与主流模型相当的精度,推理速度提升4倍,且能扩展至百万级文本处理。未来需解决渲染参数敏感性和OCR保真度等问题,并探索自适应渲染等方向。

本站注明稿件来源为其他媒体的文/图等稿件均为转载稿,本站转载出于非商业性的教育和科研之目的,并不意味着赞同其观点或证实其内容的真实性。如转载稿涉及版权等问题,请作者速来电或来函联系。

学术头条

年终拆解:爆火的AI Coding Agent是什么?有哪些“坑”?.

2025-12-29

Meta公布“超级智能”新进展:无需人类,软件Agent即可自我训练!.

2025-12-26

人人编程时代到来!智谱发布GLM-4.7:Vide Coding能力全球开源第一.

2025-12-23

全球首次实现!上海交大推出全光生成式AI芯片LightGen,研究登上Science.

2025-12-22

最新文章

@工程探索者:邀你做一个前瞻性的预测,赢Wiley定制好礼!

2026-03-16

AI太难学?清华开源一批「学习虾」,免费的AI私教团来了

2026-03-16

养只龙虾做科研?一句话自动跑实验写LaTeX,同行评审都包了

2026-03-15

ICLR 2026 | 无需训练跨界泛化,UniOD用单一模型打通全领域异常检测

2026-03-13